大普微携手 DDN 联合亮相中国生成式AI大会,构建高效AI数据底座

近日,中国生成式AI大会在北京落幕。大普微与DDN联合参展,围绕“加速大模型训练与推理的核心引擎”这一主题进行分享,介绍了双方联合打造的面向 AI 训练与推理场景的数据与存储方案。

01 携手 DDN,构建高效 AI 数据供给能力。

生成式 AI 加速落地的背景下,数据流转效率直接影响着大模型的训练与推理成效。本次会议中,大普微与 DDN 推出联合解决方案,通过存储、数据平台与网络的协同设计,打破 AI 算力的数据供给瓶颈。

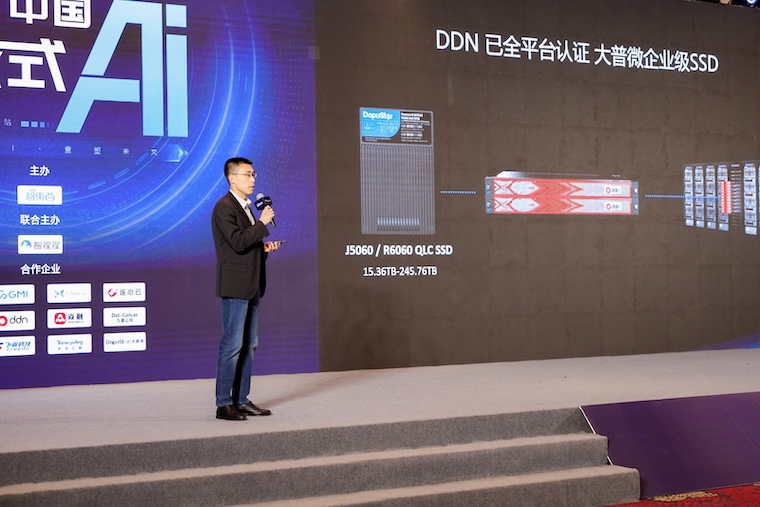

该方案依托 DDN Infinia、EXA 等数据平台及 KV Cache Fabric 机制,并深度结合 NVIDIA 技术体系。其中,大普微企业级 NVMe SSD 作为核心存储层,提供最高 245TB 的单盘容量与超高带宽支撑,有效满足大规模 AI 数据处理需求。

通过与 DDN 平台的深度集成,DapuStor SSD 在 AI 训练侧可有效加速数据喂流、降低GPU等待时间;在推理侧支持长上下文处理与 KV Cache 调用。同时,该方案在系统层面进一步降低了整体TCO,为AI数据存储和规模化部署提供有力支撑。

02 联合亮相,发表 AI 存储前沿洞见

大会期间,双方联合展台吸引了众多 AI 企业、云服务提供商及技术开发者的广泛关注。围绕大模型训练、推理加速及存储成本优化等议题,大普微与 DDN 团队与现场观众展开了深入交流,进一步深化了在 AI 基础设施领域的行业共识。

在“AI 算力基础设施”专题论坛上,DapuStor 与 DDN 共同发表了《数据智能平台:加速大模型训练与推理的核心引擎》主题演讲,分享了大普微的企业级SSD 如何集成于DDN 数据优化平台,推动 AI 时代的基础设施建设。

随着生成式AI持续演进,数据基础设施的重要性不断提升。未来,大普微将继续深化与包括 DDN 在内的全球伙伴的生态合作,为AI场景提供稳定、高效的存储支撑。